Zuletzt aktualisiert vor 10 Juli, 2023 | Veröffentlicht: 10 Juli, 2023

In Kalifornien und New York wurde eine Sammelklage gegen OpenAI eingereicht wegen 15 Rechtsbrüchen, darunter massenhafter Datendiebstahl, massenhafte Verletzung der Persönlichkeitsrechte, massenhafter Konsumentenbetrug, massenhafte Verletzung der Persönlichkeitsrechte von Kindern, Fahrlässigkeit, Schädigung der Gesellschaft durch Herbeiführung zukünftiger Massenarbeitslosigkeit etc.

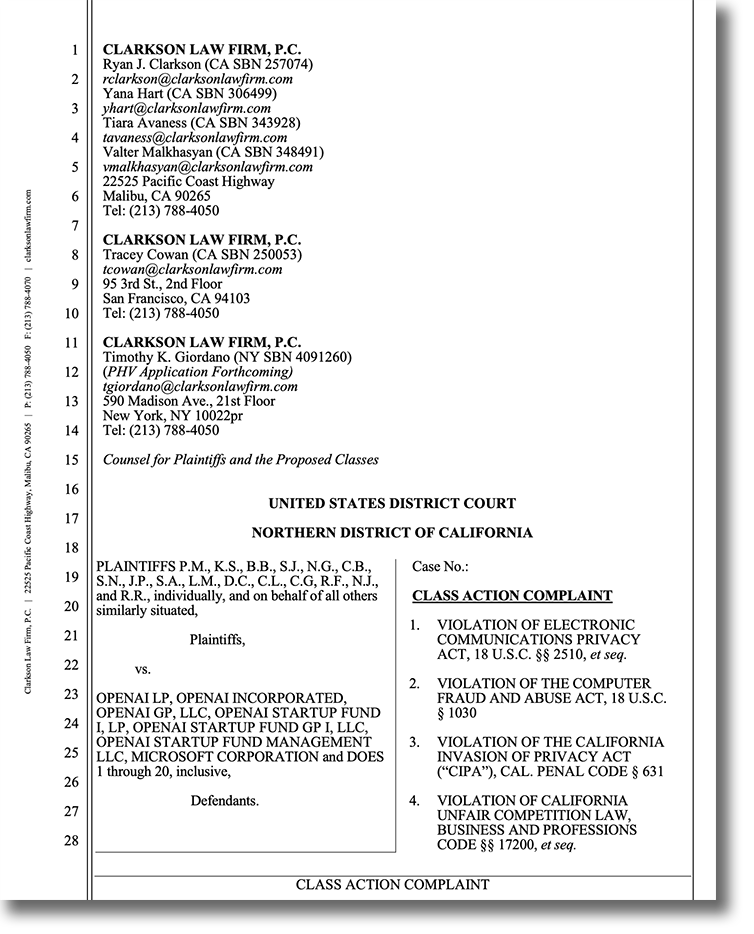

Köln, den 10.7.23, von Sebastian Paulke – Wie letzte Woche bekannt wurde, hat die US Kanzlei Clarkson Law Firm Klage eingereicht gegen OpenAI, OpenAI Fund und Microsoft, weil die Beklagten nach Dafürhalten der (anonymen) Kläger systematisch und massenhaft Gesetze gebrochen und damit erhebliche persönliche und gesellschaftliche Schäden angerichtet hätten.

Köln, den 10.7.23, von Sebastian Paulke – Wie letzte Woche bekannt wurde, hat die US Kanzlei Clarkson Law Firm Klage eingereicht gegen OpenAI, OpenAI Fund und Microsoft, weil die Beklagten nach Dafürhalten der (anonymen) Kläger systematisch und massenhaft Gesetze gebrochen und damit erhebliche persönliche und gesellschaftliche Schäden angerichtet hätten.

Die Anklagepunkte sind laut der öffentlich zugänglichen Klageschrift vor allem: Verletzung der elektronischen Privatsphäre, Computer-Betrug und -Mißbrauch, Wettbewerbsverstöße, Mißbrauch biometrischer Daten, und Daten-Diebstahl in großem Stil. In allen Anklagepunkten wurde laut der Klage millionenfach gegen geltendes Recht verstoßen, und zwar absichtlich und ausschließlich zum Zwecke der eigenen Bereicherung.

Wer die Klageschrift liest, insbesondere die Anklagepunkte (Seiten 61 – 88), kommt nicht umhin, deren Berechtigung anzuerkennen – es besteht ja kein Zweifel daran, dass die Scraper (automatisierte Sammler von Internetdaten) von OpenAI systematisch Daten jeglicher Herkunft und Urheberschaft gesammelt und in ihre AI integriert haben, inklusive Fotos, persönliche Informationen, Kommunikationen etc. Ebenso wenig kann bezweifelt werden, dass niemand gefragt wurde, ob seine Daten benutzt werden dürfen. Auch die Anklagepunkte hinsichtlich der Nutzung der Interaktionsdaten von Usern der GPT-APIs und von ChatGPT sind absolut plausibel. Insofern bestehen meines Erachtens (ich bin allerdings kein Jurist) sehr gute Chancen für eine Verurteilung zumindest in etlichen Punkten der Anklage. In diesem Falle müssen OpenAI und Microsoft mit Strafen in Milliardenhöhe rechnen. Im schlimmsten Falle könnte es zu einem Verbot von GPT-X, ChatGPT und anderen Large Language Modellen in der aktuellen Form kommen.

Karl-Heinz Land

Karl-Heinz Land, IT-Visionär, Autor und renommierter Sprecher zu disruptiven Innovationstechnologien, prognostiziert den Rückzug von OpenAI zumindest aus dem europäischen Markt und geht davon aus, dass die Konkurrenten wie Google mit Bard, Meta und Amazon ihre KIs gar nicht erst in Europa anbieten werden: „Vor dem Hintergrund des DSGVO und des in 2026 verabschiedet werdenden europäischen AI Acts kann OpenAI den ChatGPT-Service in seiner derzeitigen Form gar nicht mehr legal in Europa anbieten. Die zu erwartenden Einschränkungen und Offenlegungspflichten der Art und Weise, wie die AI mit Daten gefüttert und trainiert wird, machen das Geschäftsmodell praktisch obsolet.“

Vor allem aber, so Land, würden Unternehmen sich – mit Bezug auf den anstehenden AI Act – mit der Nutzung von GPT-X-APIs, ChatGPT im Arbeitsprozess einzelner Mitarbeiter und der Nutzung von Sprache-zu-Bilder-KIs wie Dall-E enormen Berichtspflichten unterwerfen müssen, die eine sinnvolle Nutzung dieser Technologien unmöglich machten. „Wenn jedes Unternehmen, das in seinen Arbeitsprozessen OpenAI-Technologien oder -Anwendungen einsetzt, dies nicht nur dokumentieren, sondern in den Ergebnissen (und Publikationen) kennzeichnen muss, wird der Produktivitätsgewinn der Nutzung dieser Tools ganz schnell nivelliert, wenn nicht annulliert. Nimmt man jetzt noch mögliche Rechtsfolgen der Nutzung dieser Tools wie Verbraucherklagen, Urheberrechtsprobleme oder einfach auch nur Imageschäden für die Marke hinzu, sind generative KIs für den Unternehmenseinsatz plötzlich nicht mehr so attraktiv, wie sie jetzt wirken.“

Aber was bedeutet das für die Wirtschaft, die sich von Einsatz von Large Language Modellen à la GPT-X enorme Produktivitätsvorteile erwartet? Müssen diese Unternehmen nun die Nutzung dieser Tools verbieten, ihre Mitarbeiter dazu anhalten, Inhalte wieder ausschließlich von Hand zu entwickeln?

Dazu sollten wir uns einmal anschauen, wie Unternehmen heute LLMs nutzen können. Derzeit gibt es drei Möglichkeiten, wie Unternehmen LLMs für die Erstellung von Unternehmensinhalten einsetzen:

- Unternehmen nutzen die generischen großen Sprachmodelle (LLMs) der Tech-Giganten wie ChatGPT / Microsoft oder Google. Die Probleme, die sie sich mit hoher Wahrscheinlichkeit damit in der Zukunft einhandeln, habe ich oben angesprochen.

- Natürlich können Unternehmen die Big-Tech-LLMs mit Prompting-Tools auf ihr Geschäft abstimmen. Auf diese Weise erhalten sie bessere Ergebnisse, die die Stimme der Marke widerspiegeln und den Output optimieren, aber die Qualität hängt immer noch von generischen LLMs, ständiger Abstimmung und redaktioneller Aufsicht ab. Dieser Ansatz ist für die meisten Geschäftsanwendungen noch zu unzuverlässig und ineffizient. Und vor allem – er löst nicht die rechtlichen Probleme der Nutzung von LLMs nach DSGVO / AI Act. Unternehmen, die so vorgehen, steigern die Qualität ihres Outputs, bleiben aber gleichzeitig im „rechtsunsicheren Raum“ – mit allen damit verbunden Risiken.

- Im Idealfall entwickeln Unternehmen ihr eigenes LLM mit Open-Source-Modellen – die Do-it-yourself-Methode. In diesem Fall sind die Daten und Antworten potenziell genauer, ihre Herkunft kann belegt werden, Rechte etc. könnten erworben werden. Doch der dazu erforderliche Aufwand ist vermutlich nur für BlueChips oder DAX-Unternehmen zu stemmen – die Erfordernisse an kompetentem Personal, Rechteerwerb, Technologieaufbaukosten etc. sind nicht zu unterschätzen – wir sprechen hier von Millionen Euro an Entwicklungskosten.

Jürgen Kranz

Bedeutet dies, dass Mittelstand und „normale“ Enterprises in Zukunft ohne generative KIs arbeiten müssen? „Keinesfalls“, sagt Jürgen Kranz, Technikvorstand des Enterprise AI Service Platform-Anbieters rellify, einem deutsch-amerikanischen Startup, das jüngst vom Wirtschaftsmagazin WirtschaftsWoche (WiWO) zu einem der Finalisten des Best of Technology Awards 2023 in der Kategorie Marketing & Sales gekürt wurde: „Es gibt nämlich noch einen vierten Weg, wie Unternehmen generative KI sicher und vertrauenswürdig maßgeschneidert für ihre Bedürfnisse nutzen können.“ Mit der automatisierten AI Model Building Engine von rellify könnten Unternehmen ihr eigenes generatives KI-Modell – ein sogenanntes NEURAVERSE – als Model-as-a-Service (MaaS) nutzen und in ihrem Unternehmen einsetzen.

Doch was ist ein NEURAVERSE? Kranz erklärt das Produkt folgendermaßen: „Ein NEURAVERSE ist im Prinzip ein auf ein bestimmtes Dachthema fokussiertes Language Model. Es entsteht, indem die Webseiten des Kunden und seiner wichtigsten Wettbewerber gecrawlt und mit unserer Machine-Learning-KI-Technologie analysiert werden. So entsteht ein gewisses Verständnis der Themen und Inhalte des betreffenden Geschäftsmodells. Mit diesem Verständnis dann googlet unsere KI Tausende Begriffe und folgt den Links. Diese Zielseiten werden dann wiederum gecrawlt und von der Machine-Learning-Instanz analysiert und klassifiziert.“ So entstünde ein themenspezifisches Language Model, das nur auf themenrelevanten Internetinhalten basiere, die alle dokumentiert und belegbar seien.

Unternehmen, die so ein NEURAVERSE nutzten, so Kranz, profitierten von verschiedenen Vorteilen: „Zum einen ermöglicht das NEURAVERSE einem Kunden, sein Thema in einer bisher nicht gekannten Tiefe zu verstehen und Unterthemen, Aspekte und Begriffe nach Relevanz einordnen zu können. Die Ergebnisse eines NEURAVERSE sind innerhalb des bestimmten Dachthemas, für das es erstellt wurde, deutlich präziser und detaillierter, als das ein Large Language Model darstellen könnte. Ein anderer Vorteil ist, dass das in diesem NEURAVERSE akkumulierte Wissen dem Kunden gehört – und niemand anderes dieses Wissen nutzen kann. Das schafft einen spürbaren Wettbewerbsvorteil. Und nicht zuletzt bietet die Nutzung eines NEURAVERSEs unseren Kunden auch rechtliche Vorteile: Sie können bei Bedarf alle Quellen genau belegen. So könnten beispielsweise Daten, für die keine Nutzungsrechte bestehen, aus dem System entfernt werden.“

„Aber ganz unabhängig von unserer Lösung“, fasst Kranz zusammen, „glaube ich im Gegensatz zu Herrn Land nicht, dass die Klage gegen OpenAI die Large Language Model-Landschaft stark erschüttern wird.“ Die Technologie der großen generativen KIs sei schlicht zu produktiv, als dass sie sich noch verhindern ließe. „Die Wirtschaft hat schon immer – und wird auch immer – jeden technischen Produktivitätsboost nutzen, um billigere oder bessere Produkte und Leistungen anbieten zu können. Sicherlich wird es eine gewisse Regulierung geben, was auch wichtig und gut ist, aber ich sehe kein Szenario, in dem sich die zunehmende Integration Künstlicher Intelligenzen in alle Arbeits- und Lebensbereiche noch stoppen ließe,“ so der KI-Experte. Und außerdem, so Kranz, dürfe man auch das Technologie-Race zwischen den USA und China außer Acht lassen: „China wird sich sicherlich keine Hürden in den Weg zur KI-Supermacht stellen. Und ebenso sicher werden die USA den Chinesen nicht die KI-Technologiehoheit überlassen. Insofern läuft es aus meiner Sicht darauf hinaus, dass zwar einige Verbraucher- und Urheberrechte besser reguliert und geschützt werden, ein Ende der KI-Forschung und Entwicklung wird das jedoch meines Erachtens keinesfalls bedeuten. Dazu sind die positiven Verheißungen dieser neuen Technologien schlicht zu vielversprechend.“

Autor: Sebastian Paulke

Autor: Sebastian Paulke

… hat in den vergangenen 25 Jahren über 1.200 Fachbeiträge, aber auch viele Studien und Untersuchungen zu Innovationstechnologien veröffentlicht. Er ist Forschungsprofessor für AI am International Innovation Center der Universität Hankou, in Wuhan, China.

Bei rellify ist Sebastian Paulke für die Unternehmenskommunikation sowie für Content Strategien verantwortlich.